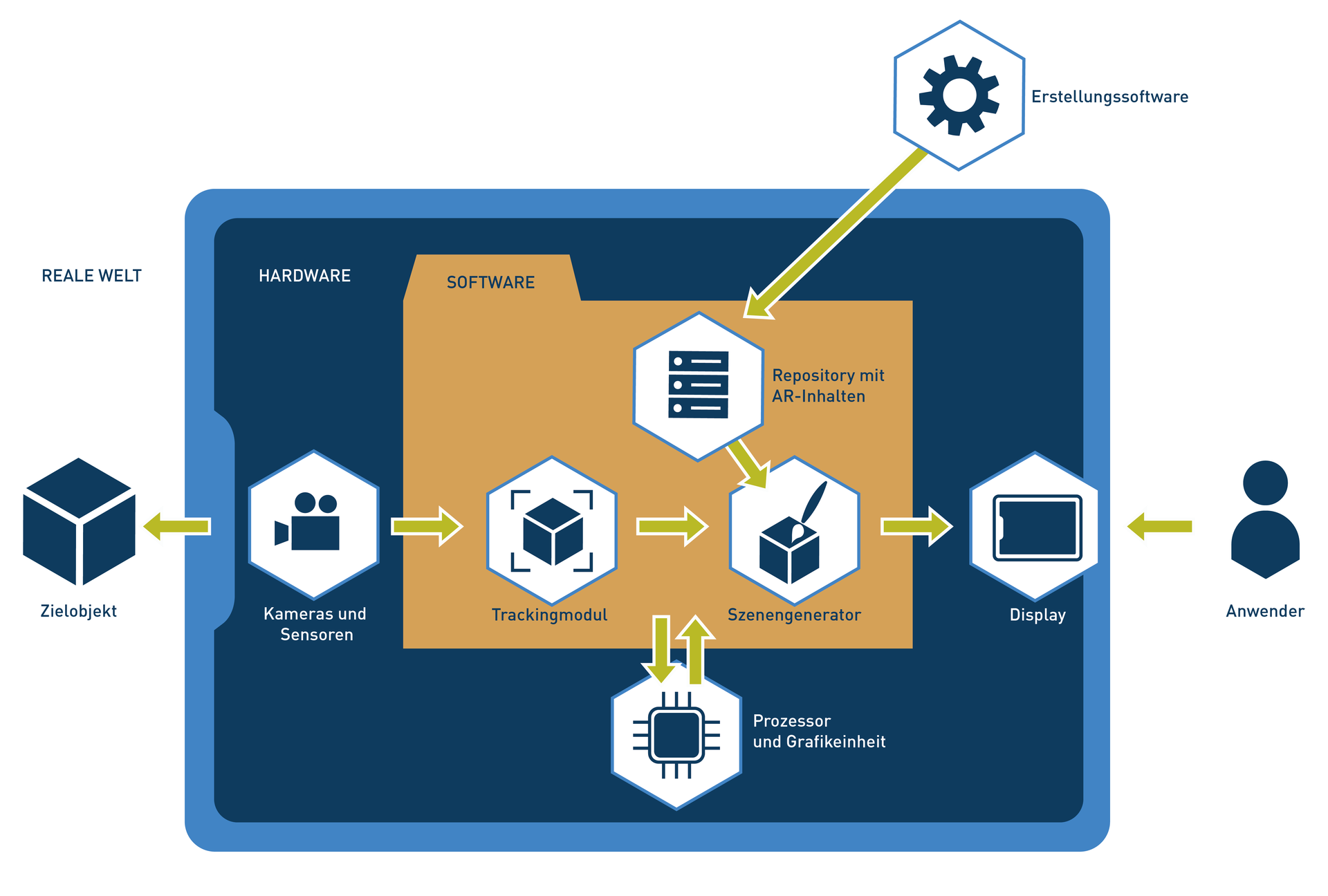

Software, Hardware und die reale Welt: Wie ein AR-System aufgebaut ist

4 Min.

Die zentralen Hardware-Komponenten eines AR-Systeme setzen sich aus Sensoren bzw. Kameras, Prozessoren und Displays zusammen:

Sensoren und Kameras – Die Wahrnehmungsorgane

Sensoren und Kameras können als die Wahrnehmungsorgane des AR-Systems verstanden werden. Sie erfassen die Realität und liefern Daten, die für Tracking und die Mustererkennung benötigt werden. Je präziser und hochwertiger diese Erfassung ist, desto besser ist die Grundlage, auf deren Basis später die virtuellen Inhalte eingebunden werden.

Sensoren können darüber hinaus weitere Informationen über die Umgebung oder den Zustand einer Maschine bereitstellen. Dazu gehören z. B. Daten zu Temperatur, pH-Wert oder Lichtverhältnissen. Besonders bei Service und Wartung im Kontext Industrie 4.0 bietet das Einbeziehen und Auswerten zusätzlicher Sensordaten einen entscheidenden Mehrwert.

Die gesammelten Daten werden an eine AR-Anwendung übergeben, die auf dem Endgerät installiert ist.

Tracking-Modul

Das Tracking-Modul prüft, ob in den übermittelten Daten ein bekanntes Muster enthalten ist. Falls ein Zielobjekt erkannt wird, wird diese Information an den Szenengenerator weitergegeben.

Szenengenerator

Der Szenegenerator kombiniert mithilfe einer Render Engine reale und virtuelle Welt. Dazu greift er auf ein Repository zurück, dass sämtliche virtuellen Inhalte enthält. Anhand der Informationen von Trackingmodul und Repository wird eine kombinierte Szene generiert. Anschließend wird die gerenderte Szene auf einem Display dargestellt.

Displays – Das Erscheinungsbild

Die Anzeige kann über konventionelle visuelle Displays, wie Bildschirme, AR-Brillen oder Projektoren, erfolgen aber auch über multisensorische Displays, die andere Sinneseindrücke, wie Haptik oder Geruch miteinschließen.

Prozessor und Grafikeinheit –Das Gehirn

Bei der gesamten Verarbeitung von Daten, Ausführung von Aktionen und Interaktionen sowie der Darstellung spielen Prozessor und Grafikeinheit eine zentrale Rolle. In vielen mobilen Endgeräten sind diese beiden Komponenten als APU in einem Bauteil zusammengefasst. Die APU interagiert mit der AR-Anwendung und trägt die "Arbeitslast". Auf Grund ihrer Funktionalität kann sie als Gehirn des Systems verstanden werden.

Die Belastbarkeit des Gehirns ist entscheidend dafür, dass alle Prozesse und Interaktionen zügig verarbeitet und ausgewertet werden können. Auch die Qualität der Darstellung ist vom Gehirn abhängig. Ist es überlastet, gibt es in der Darstellung, selbst bei Einsatz eines hervorragenden Displays, Abstriche in der Darstellung und die wiedergegebenen Inhalte wirken ruckelig und verzögert.

Welche Endgeräte kommen in Frage?

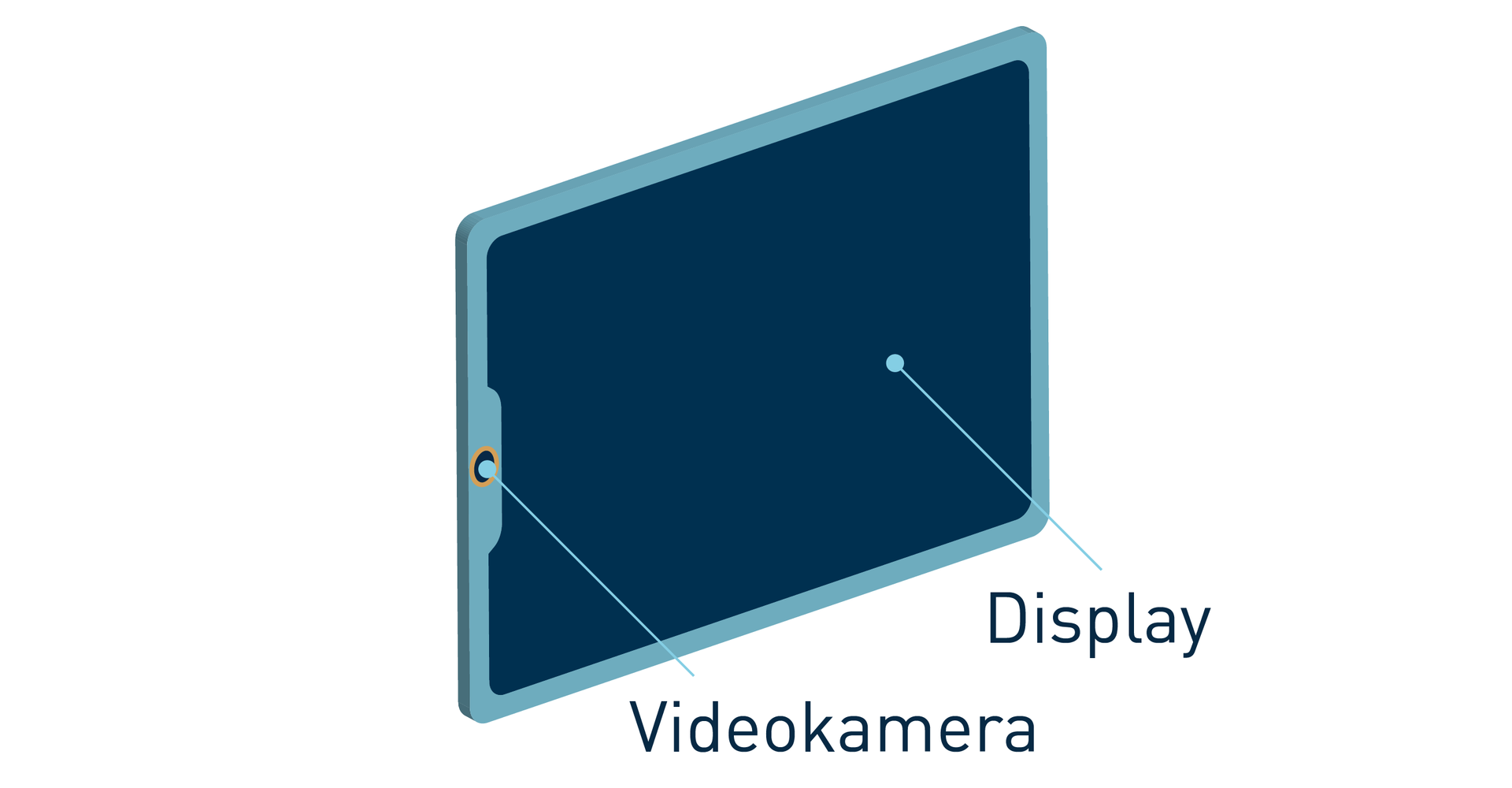

Augmented Reality kann auf einer Vielzahl von Geräten genutzt werden – von AR-Brillen über Head Up Displays, kurz HUD, z. B. Windschutzscheiben oder Helme, bis hin zu Smartphones und Tablets. Aktuell wird AR am häufigsten auf Smartphones und Tablets verwendet.

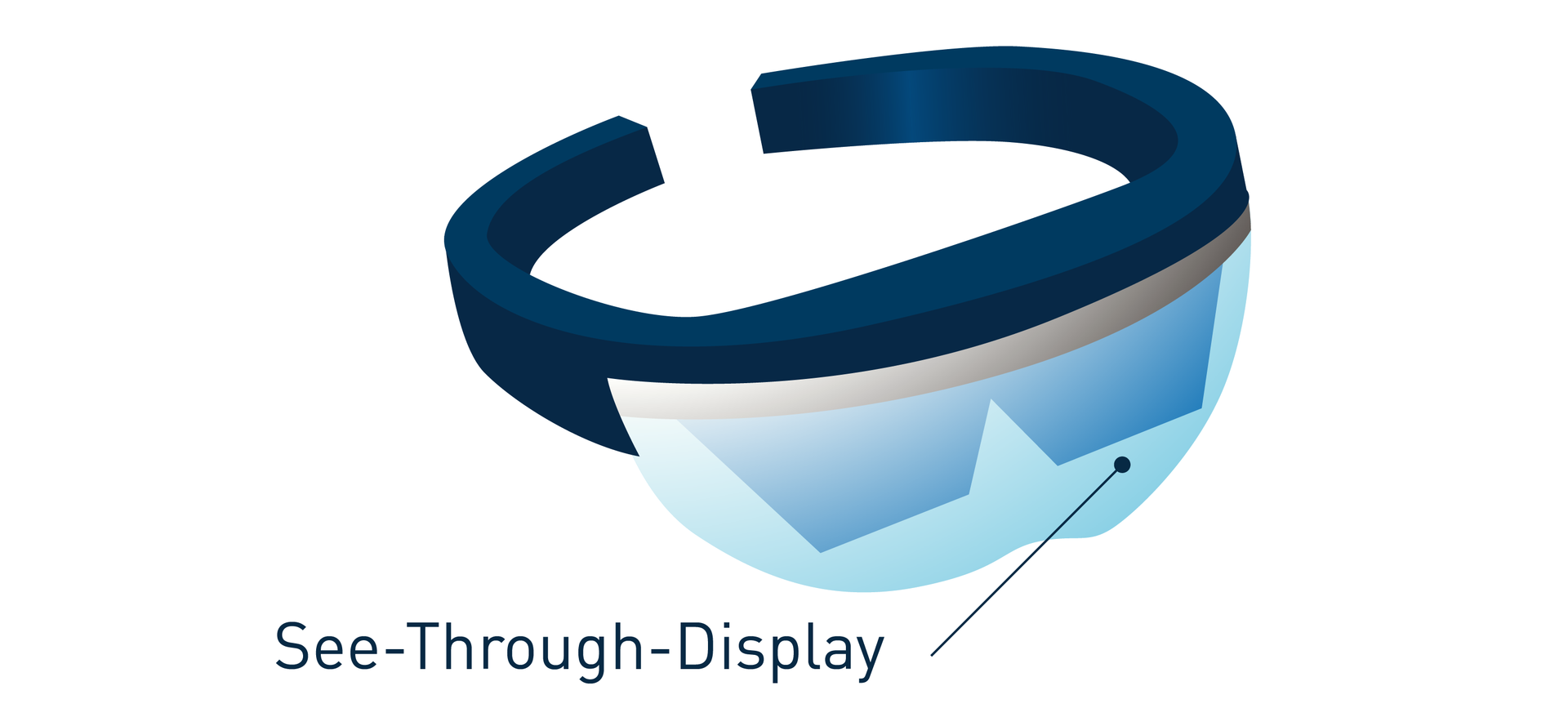

Grundlegend können Endgeräte ausgehend von ihrem Aufbau und ihrer Funktionsweise in 3 Kategorien unterteilt werden: Optical-See-Through, Video-See-Through und projektionsbasierte AR.

Optical-See-Through

Optical-See-Through-Displays erlauben eine Durchsicht auf die reale Umgebung. Der Anwender sieht sein Umfeld durch eine semitransparente Projektionsfläche. Über diese Projektionsfläche werden die ergänzenden AR-Inhalten direkt ins Blickfeld des Anwenders integriert. Typische Ausgabegeräte des Typs Optical-See-Through sind die Microsoft HoloLens und andere AR-Brillen wie die Epson Moverio BT-200 oder die Meta 2.

Video-See-Through

Anders als bei Optical-See-Through-Displays gestatten es Video-See-Through-Displays nicht durch das Ausgabegerät hindurchzusehen. Stattdessen wird die Außenwelt in einem Video aufgezeichnet. Die AR-Inhalte werden in diesen Videostream integriert. Über das Display eines Ausgabemediums werden nicht nur die AR-Inhalte ausgegeben, sondern ein augmentierter Videostream. Dadurch entsteht der Eindruck, dass durch das Ausgabegerät hindurchgesehen werden kann. Typische Endgeräte, des Typs Video-See-Through sind Smartphone, Tablet, aber auch AR-Brillen wie die Google Glass oder die Vuzix M4000.

Projektionsbasierte AR

Im Gegensatz zu Video-See-Through- und Optical-See-Through-Displays werden AR-Inhalte bei projektionsbasierten AR-Anwendungen direkt auf ein reales physisches Objekt projiziert. Dabei befindet sich kein Anzeigemedium zwischen dem Auge des Anwenders und der realen Umgebung.

Welche Hardware ist geeignet?

Welche Hardware für ein Augmented-Reality-Projekt geeignet ist, hängt maßgeblich von der Zielgruppe, dem Anwendungskontext und dem verfügbaren Budget ab. Die nachstehende Tabelle zeigt die Vor- und Nachteile der geläufigsten AR-Endgeräte:

Smartphone/Tablet, Video-See-Through

Pro

- Weit verbreitetes Endgerät

Eine Vielzahl von potenziellen Anwendern nutzt die Endgeräte/ kann die Endgeräte nutzen und ist in der Handhabung routiniert. - Gutes Preis-Leistungs-Verhältnis

Contra

- Ohne Sonderkonstruktion keine freien Hände

Smart-Glasses, Video-See-Through

Pro

- Freie Hände

Contra

- Kosten

- Bei Anwendern weniger verfügbar und bekannt

- Aktueller Entwicklungsstand ist für viele Einsatzszenarien unzureichend

Smart-Glasses, See-Through

Pro

- Freie Hände

- Einblendung direkt ins Sichtfeld

Contra

- Kosten

- Bei Anwendern weniger verfügbar und bekannt

- Aktueller Entwicklungsstand ist für viele Einsatzszenarien unzureichend

- Gewicht

Neben der Hardware und den grundlegenden Komponenten einer AR-Anwendung ist auch die Erstellungssoftware von entscheidender Bedeutung.

Die unterschiedlichen Arten der Erstellungssoftware

Im Bereich Erstellungssoftware existieren eine Vielzahl unterschiedlicher Anbieter. Das Angebot reicht von Umfangreichen Komplettlösungen bis hin zu "freien" Entwicklungsumgebungen, in denen die einzelnen Software-Komponenten beliebig miteinander kombiniert werden können.

Komplettlösungen wie Reflect One oder Vuforia Studio bieten eine definierte Entwicklungsumgebung, in der häufig benötigte Funktionalitäten standardisiert verfügbar sind. AR-Anwendungen lassen sich mit Hilfe solcher Systeme ohne Programmierkenntnisse und mit geringem Zeitaufwand umsetzen. Zudem sind sie speziell auf den industriellen Einsatz ausgelegt und bieten Funktionalitäten zur Anbindung an andere Systeme wie CCMS, SAP und PIM. Allerdings sind die vorhandenen Funktionalitäten beschränkt und können in der Regel nur durch den Softwarehersteller erweitert werden.

Andere Entwicklungsumgebungen wie Unity 3D oder Unreal Engine bieten deutlich mehr Freiraum. Hier können unterschiedliche SDKs flexibel eingebunden werden. Hinsichtlich der verfügbaren Funktionalitäten gibt es kaum Einschränkungen und alles kann selbst definiert werden. Allerdings ist diese Definition auch ein Muss. Das bringt zwei Nachteile mit sich: Zum einen ist mit einem deutlichen Mehraufwand bei der Erstellung zu rechnen. Zum anderen sind zur Implementierung aller Funktionen und Interaktionsmöglichkeiten zwingend Programmierkenntnisse notwendig.

Welche Lösung ist die passende?

Bei der Konzeption eines AR-Systems müssen viele technologische Entscheidungen getroffen werden. Der Aufbau des AR-Systems und die Entscheidung für eine Entwicklungsumgebung sind dabei zentrale Meilensteine, die das Endergebnis und die Arbeitsweise maßgeblich beeinflussen. Bezüglich Hard- und Software gibt es einige allgemeingültige Richtwerte, an denen man sich orientieren kann: Prozessor und Grafikeinheit sollten leistungsstark sein und an die Wahrnehmungsorgane, wird der Anspruch gestellt, die reale Umgebung so präzise wie möglich zu erfassen. Doch was genau heißt das?

Darüber hinaus bestehen nicht für alle Aspekte grundlegende Empfehlungen. Welcher Aufbau und welche Entwicklungsumgebung optimal für ein AR-Projekt geeignet sind, hängt von vielen Faktoren ab, sodass keine pauschale Antwort möglich ist.

Sie fragen sich, wie sie das optimale AR-System für ihren Anwendungsfall aufbauen und einzelne Komponenten kombinieren können. Wir stehen Ihnen gerne als Beratungs- und Realisierungspartner zur Seite.